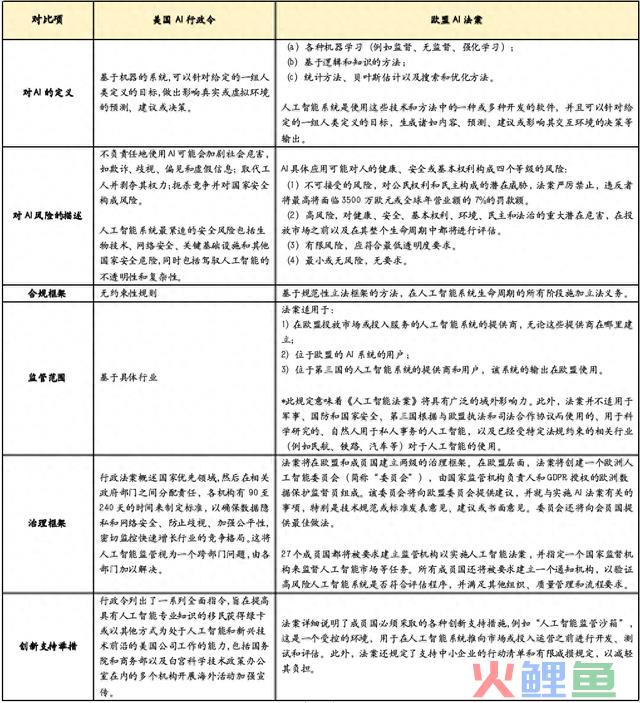

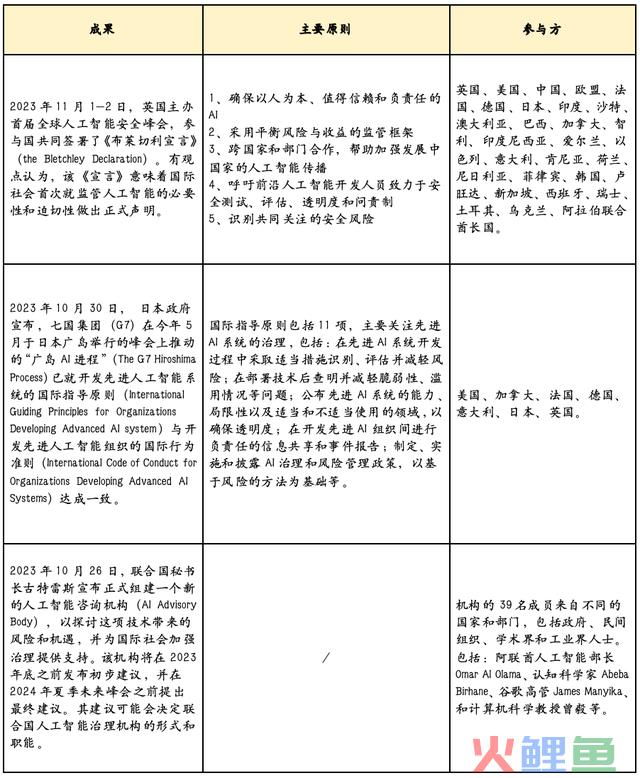

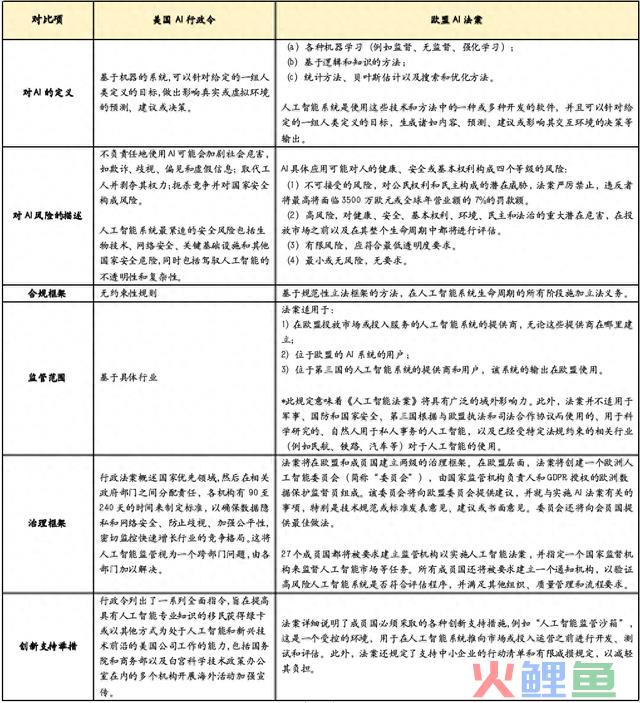

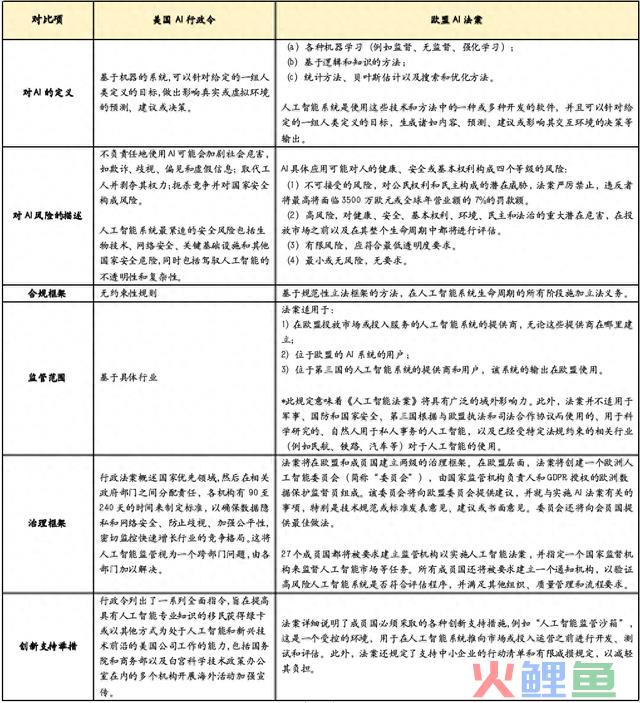

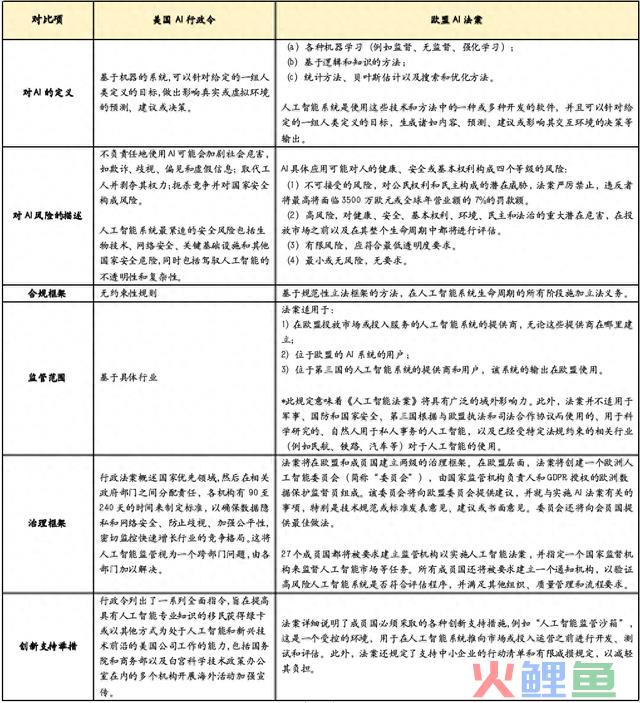

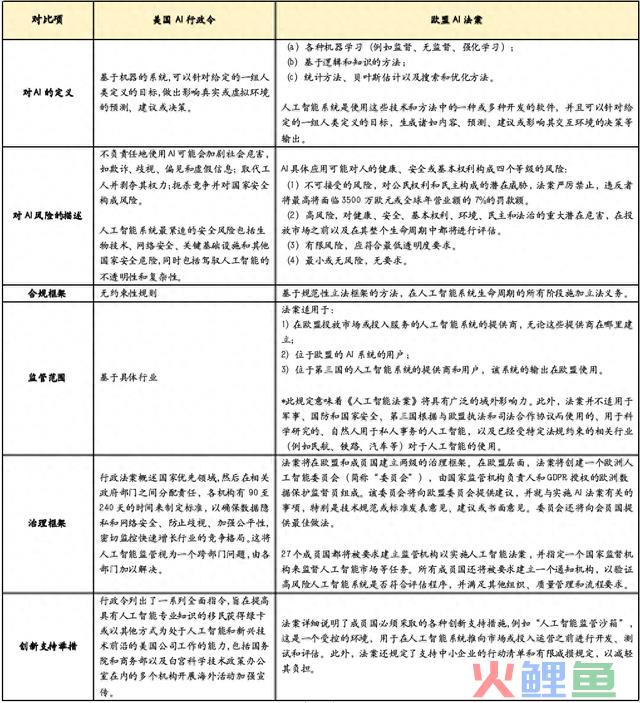

(本文作者中国金融四十人论坛)“2023年,野生智能(AI)技术的创新与利用日新月异,同时也带来多重风险与监管应战,已有多个经济体正在起草或预备推出AI指导原则或法案。整体而言,今朝列国对于AI监管的原则与方式仍存较大差别,且由于AI政策与地缘政治、经济合作等身分慎密交织,全球层面的AI治理合作仍未获得具体功效。本文试图回首2023年全球层面AI治理停顿,对照美欧等经济体监管政策差别,并对未来全球AI治理合作偏向停止展望。2023年是野生智能(AI)技术创新与利用日新月异的一年,以ChatGPT为代表的天生式野生智能(Generative AI)的出现意味着人类离通用野生智能(AGI)的实现又进了一步,先辈AI技术的普遍摆设将有能够完全改变人们的生活生产方式,带来史无前例的经济增加和社会进步。但与此同时,AI技术利用及各大科技企业之间剧烈的技术合作也激发了各界对于伦理、平安等题目标不安。有概念以为,一旦野生智能出现意外成长,或对人类社会形成严重威胁,极端情况下甚至能够带来堪比核战争的扑灭性影响。面临这样布满庞大潜力与风险的技术,全球列国与国际层面起头采纳行动试图平衡创新与平安。今朝中国、美国、欧盟、加拿大、英国、日本、巴西、新加坡等经济体正在起草或预备推出野生智能指导原则或法案,英国AI平安峰会等会议的召开也试图鞭策听工智能平安治理国际合作。值得留意的是,列国对于AI监管的原则与方式仍存较大差别,且由于AI政策与地缘政治、经济合作等身分慎密交织,全球层面的AI监管合作今朝仍未获得具体功效。这能够致使全球野生智能监管政策的碎片化,增加相关企业合规本钱并障碍创新,也能够发生监管缝隙从而致使野生智能风险分散。本文试图回首2023年全球层面AI监管停顿,对照美欧等经济体监管政策差别,并对未来全球AI治理合作偏向停止展望。AI的潜伏风险与AI监管的多重应战关于AI技术的潜伏风险,全球技术专家存在分歧看法,这也反应在列国AI监管的分歧偏重点上。整体来看,这些定见首要分为三派[1]:第一派概念关注AI的久远影响,以为未来能够会诞生超级野生智能,对人类保存组成威胁;第二派概念关注AI对当下的现实影响,以为AI系统已经加重了对性别种族的轻视、对弱势群体的榨取、冤仇谈吐与假消息的传布等题目;第三派概念关注AI技术合作与国家平安题目,以为AI技术若被恶意操纵,势必威胁国家平安,而一旦其他国家获得先机,将会削弱本国合作上风。对于AI监管面临的困难与应战,布鲁金斯学会拜候学者、美国联邦通讯委员会原主席汤姆·惠勒(Tom Wheeler)将其归纳为三个方面[2]:第一,监管速度。斟酌到AI技术惊人的进步与迭代速度,监管速度能否跟上成为一浩劫点。一方面,AI技术成长已经超越政府现有专业常识范围,监管部分需要吸纳更多专业人材以更好了解、识别并评价技术风险;另一方面,现有监管法则普遍并不灵活,需要转向加倍灵敏的监管方式。第二,监管范围。AI技术具有多样的利用处景,“一刀切”式监管常常会在某些情况下致使过度监管或监管不敷,是以AI监管必须以具体风险为根本,针对性实施。此外,监管气力不但需要避免AI用于欺骗等不法活动、处置屡见不鲜的数字滥用,还需应对AI能够给人类社会带来的任何有害的未知身分。第三,谁来监管以及若何监管。谁来监管触及是基于现有制度还是构建新制度监管的题目,若何监管则触及具体方式:数字时代需要避开产业式运营、拥抱新形式监视的机构,包括在监管AI进程当中利用AI。这类监管应偏重于减轻技术的影响,而不是对技术自己停止微观治理。列国AI监管停顿与异同点对照2023年首要国家的AI监管停顿与具体政策,可以发现列国的AI治理思绪仍存较大差别,甚至在美欧发财经济体之间,分歧点也多过类似点。1、配合点综合多个国家与国际机构起草的AI治理文件来看,各方在AI监管原则上首要有五方面配合点:一是夸大通明度、可追溯性与可诠释性;二是夸大数据庇护、隐私与数据平安;三是夸大应战或改正AI决议,识别并治理相关风险;四是制止偏见或轻视,并究查人类义务;五是制止滥用技术及不法活动,并保证人类知情权。2023年10月末,美国白宫公布拜登签订的《关于平安、牢靠和可信的AI行政令》;2023年12月初,欧盟就《野生智能法案》告竣协议。对照来看,美国AI行政令与欧盟AI法案草案具有一些类似之处,两者都采纳了基于风险的监管原则,都较为关注高风险AI系统并制定了具体的监管原则,针对新出现的天生式AI技术引入了对根本模子的表露或测试要求。2、分歧点相对而言,美国采纳了一种去中心化、针对具体行业、非强迫性的监管方式。去中心化表现在监管架构上,行政令操纵现有机制的权利,指示政府各部分对各自范畴的AI平安风险停止评价与制定标准,而没有设立新的律例或新的监管机构。比如,假如AI被用于消耗者讹诈,则由美国联邦贸易委员会负责监管。非强迫性则表现在监管方式上,行政令并没有规定具体的履行条目,而且今朝为止联邦层级的监管都是经过非限制性的行政指令与企业自愿许诺鞭策,而非立法手段鞭策。监管的偏重点方面,行政令首要关注AI触及的平安题目,特别是国家平安,此外还关注经过吸纳人材增强AI技术创新与合作力。很多专家以为,经过行政指令停止监管虽然具有法令效力,但仅限于国会已经核准的权限,国会需要完成联邦层级的立法。首要来由有三点:第一,行政令监管没法覆盖全数范畴,特别在隐私庇护方面,除非国会立法,否则行政令感化有限;第二,今朝有些州已经各自鞭策AI监管立法,但各州分而治之能够致使法则纷歧致,给企业形成合规困难,也能够会在公众层面形成紊乱;第三,总统换届能够将现有的行政令全盘颠覆。但是,大大都分析猜测,斟酌到大选邻近、国会内部延续的政治两极分化、功用严重平衡以及美国历来偏向市场导向的自在听任监管方式,短期来看美国国会不太能够经过任何成心义的AI立法。欧盟一向以来都在数字科技监管方面走得更快,对AI技术的监管也是如此。整体而言,欧盟AI法案采纳了一种周全、横向、基于风险的监管方式。监管架构上,欧盟AI法案采纳了自上而下的两重监管结构,欧盟层级将设立野生智能办公室以监视最早辈AI模子标准与测试,成员国层级的市场监视机构则负责法律。监管范围上,并未区分具体行业,而是对AI技术在具体利用处景的风险停止分级并采纳响应的行动,并对AI系统的供给者和利用者规定了复杂细致的要求与义务。监管严厉水平上,相比美国,欧盟更偏向利用“大棒监管”,比如法案中就包括了多少赏罚性条目。不外,欧盟的AI监管政策还面临着诸多应战。首先,部分阻力来自成员国内部的分歧。在草案的谈判时代,法国和德国就为庇护外乡AI企业的合作力而否决对根本AI模子停止周全监管,偏向于经过非强迫性的行为原则停止自我监管。对此,欧盟委员会为保全全部法案最初作出了妥协,在草案中对根本模子实施分层监管的法子,整体上削弱了监管强度。其次,法案间隔周全实施最少还有两年时候,但是技术成长日新月异,到那时法案能否仍对新技术具有适用性仍未可知。第三,法案的具体实施结果也能够在各成员国中大打折扣。

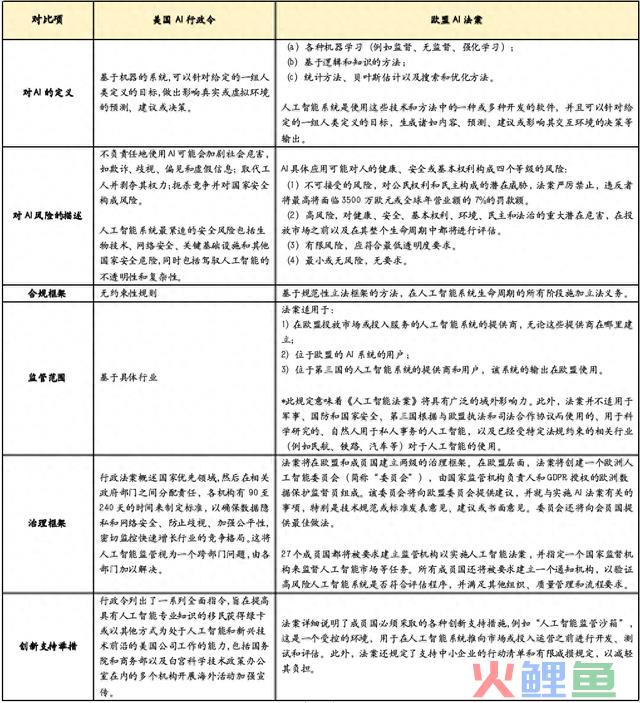

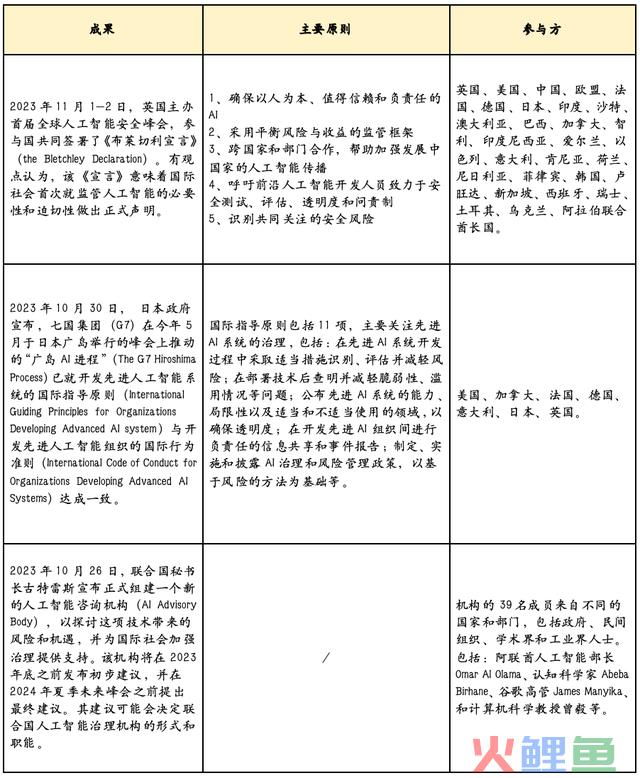

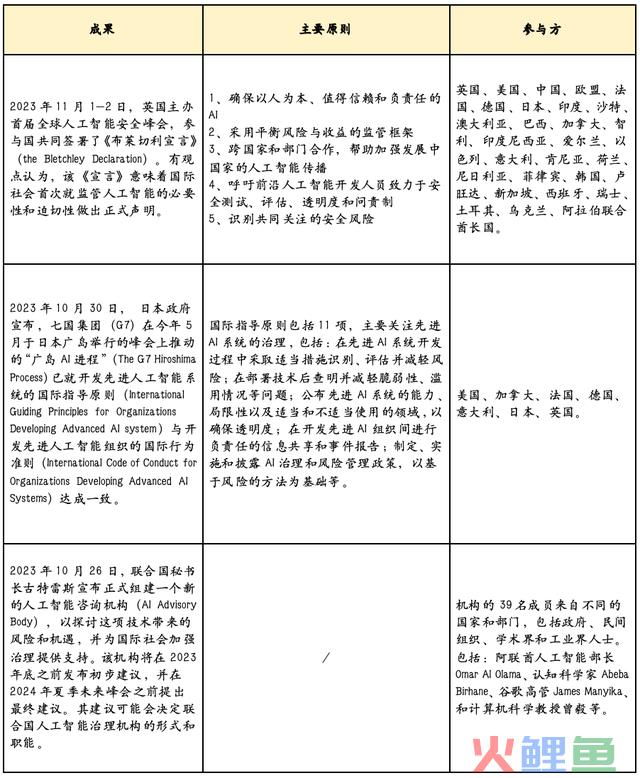

其他国家中,英国更偏向于操纵现有制度监管AI技术,日本正在起草非约束性的AI指导方针,两个国家都避免采纳过于约束性的手段以促进技术创新。中国一样走在立法监管AI的前线。卡内基国际战争研讨院研讨文章提出,中国采纳了一种较为分离、垂直、迭代的监管方式[3]。分离、垂直表现在监管范围上,对技术的特定利用或表示形式停止针对性监管,包括保举算法、深度分解技术与天生式AI技术。监管方式偏向迭代,即经过新律例来完善监管机制或扩大监管范围,这类方式有益于监管跟上技术进步速度,但迭代进程中能够会让企业面临合规方面的困惑。此外,监管偏重点在于算法和数据的利用。全球AI治理合作停顿与展望1、全球合作停顿缓慢全球层面,2023年并未出现针对AI监管或治理而构建的本色性机制或政策,大大都都是非约束性的指导原则(见表2)。整体来看,全球AI监管合作停顿缓慢。有分析以为,这是由于野生智能政策与地缘政治、经济合作日益交织,列国在协商进程中不成避免地会发生好处抵触。

2、AI竞合中的中美欧有专家以为,在全球AI合作治理缺席的情况下,中美欧三方首要气力能够会向全球推动各自对野生智能时代的分歧愿景、争取对未来技术的控制权并扩大本身在数字天下的势力范围,其他国家则面临进入哪个势力范围的挑选[4]。由于欧盟法案的域外适用性以及辐射全球的“布鲁塞尔效应”,有专家倡议美国经过美欧贸易与技术委员会(TTC)与欧盟增强监管合作、对齐监管原则[5]。还有专家以为,美欧应与中国在AI监管方面增强打仗、进修中国经历并摸索各方能否就AI监管达玉成球共鸣[6]。3、全球合作的需要性与政策倡议有概念提出,由于AI技术的分散不受版图限制,AI模子一经公布即可无处不在,破裂的监管方式必定发生缝隙与风险,是以建立全球范围的AI监管框架势在必行。理想的治理原则包括重视事前防备(precaution)而非事后解救,并连结反应的灵活灵敏(agile)[7]。今朝对全球AI监管合作的争议点之一在于合作应当基于怎样的机制。今朝比力突出的倡议试图复制现有的多边机构:结合国秘书长古特雷斯等人呼吁建立AI范畴的“国际原子能机构”(IAEA for AI),像国际原子能机构监测核技术一样监测AI技术成长;英国AI平安峰会则倡议建立AI范畴的“政府间天气变化专门委员会”(IPCC for AI),即建立一个自力的、由专家带领的机构,公道、客观、实时地向政府传递AI才能现状,并对未来情形做出基于证据的猜测,以避免好处抵触[8]。不外,上述倡议均在分歧水平遭到了技术专家的批评。综合多位专家定见来看,现有机制自己并不敷够有用,且由于AI技术快速迭代、普遍分散、威胁方式不肯定、练习基于虚拟数据等特别性以及其首要由至公司而非政府掌控,与天气变化或核分散题目有明显区分,现有机制的监管逻辑并不能适用AI技术。有专家以为,只要在建立可以让企业和列国政府都承当义务的法则法令的条件下,国际监管机构才能够发挥感化,是以列国政府应当首先敲定监管法则的先决条件和具体内容,而且就监管的重要原则告竣分歧,然后再让机构停止监管[9]。别的,新的合作机制需要建立在对AI成长及治理原则的共鸣之上,需要连结监管法则的灵活灵敏,且需要妥帖应对地缘政治方面的应战。参考文献[1]Bruce Schneier and Nathan Sanders. (2023, September 28). Opinion | Elon Musk, Geoff Hinton, and the War Over A.I. Nytimes. https://nytimes.com/2023/09/28/opinion/ai-safety-ethics-effective.html[2]TomWheeler. (2023, June 15). The three challenges of AI regulation. Brookings.https://brookings.edu/articles/the-three-challenges-of-ai-regulation/[3]Matt Sheehan. (2023, July 10). China's AI Regulations and How They Get Made - Carnegie Endowment for International Peace. Carnegieendowment.https://carnegieendowment.org/2023/07/10/china-s-ai-regulations-and-how-they-get-made-pub-90117[4]Anu Bradford. (2023, June 27).The Race to Regulate Artificial Intelligence. Foreignaffairs.https://foreignaffairs.com/united-states/race-regulate-artificial-intelligence[5]Alex Engler. (2023, April 25). The EU and U.S. diverge on AI regulation: A transatlantic comparison and steps to alignment. Brookings.https://brookings.edu/articles/the-eu-and-us-diverge-on-ai-regulation-a-transatlantic-comparison-and-steps-to-alignment/[6]Mark MacCarthy. (2023, October 19). The US and its allies should engage with China on AI law and policy. Brookings.https://brookings.edu/articles/the-us-and-its-allies-should-engage-with-china-on-ai-law-and-policy/[7]Ian Bremmer & Mustafa Suleyman (2023, August 16).The AI Power Paradox: Can States Learn to Govern Artificial Intelligence—Before 's’s Too Late?. Foreignaffairs.https://foreignaffairs.com/world/artificial-intelligence-power-paradox[8]Mustafa Suleyman and Eric Schmidt: We need an AI equivalent of the IPCC. (2023, October 19). Financial Times.https://ft.com/content/d84e91d0-ac74-4946-a21f-5f82eb4f1d2d[9]Marietje Schaake. (2023, December 21). The Premature Quest for International AI Cooperation | Foreign Affairs. Foreignaffairs.https://foreignaffairs.com/premature-quest-international-ai-cooperation(本文作者中国金融四十人论坛)本文仅代表作者概念。